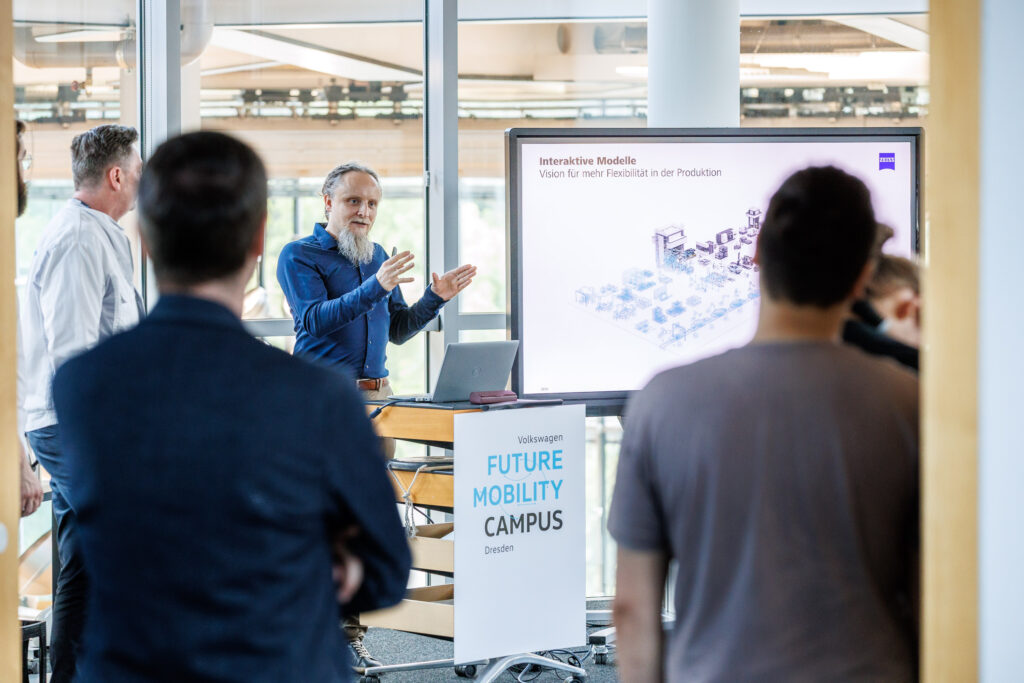

Wie bringt man eine physische Produktionshalle in die digitale Welt? Diese Frage stand im Mittelpunkt des Thin[gk]athons, mit ZEISS Digital Innovation und Volkswagen Sachsen als Challenge-Owner. Das Co-Innovations-Format des Smart Systems Hubs schafft den methodischen Rahmen, um hochaktuelle Herausforderungen gemeinschaftlich zu bewältigen. Diesmal lautete das Motto „Taking Virtual Shopfloor to the Next Level“ und lud ambitionierte Köpfe mit unterschiedlichem fachlichem Hintergrund ein, gemeinsam die Grenzen der Digitalisierung auszuloten. Das Ergebnis: interdisziplinäre Teams, in denen frische Perspektiven auf vielfältige Erfahrungen trafen, um innovative Lösungen zu entwickeln.

Die Herausforderung: Digitalisierung greifbar machen

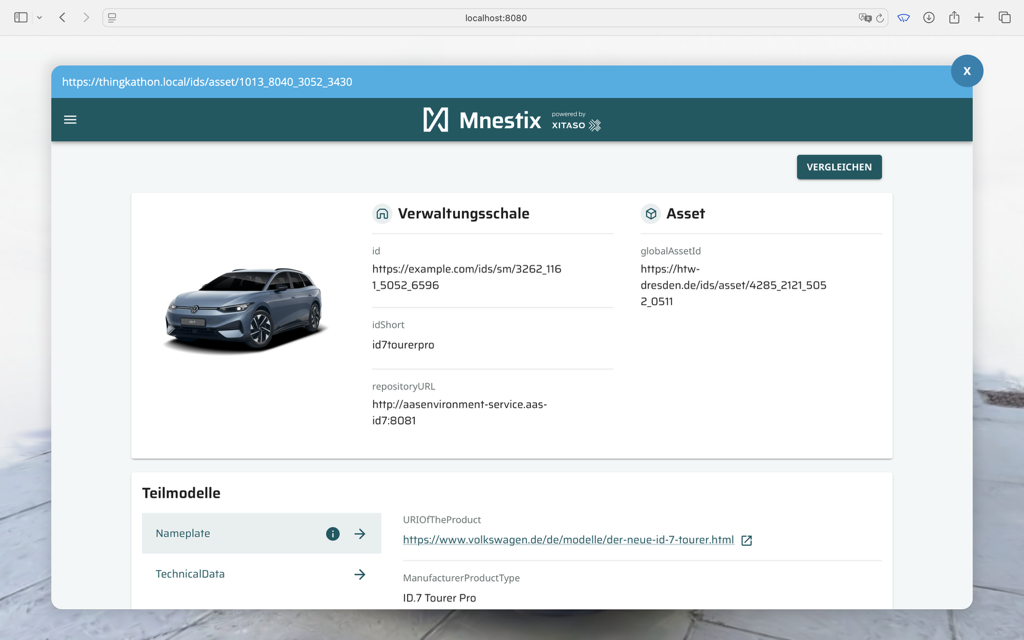

Im Zentrum der Challenge stand die Aufgabe, reale Produktionsdaten in eine virtuelle 3D-Welt zu überführen – interaktiv, skalierbar und praxisnah. Die Teams mussten gescannte Produktionsumgebungen, die aus Punktwolken und Bildern bestanden, mit digitalen Produktpässen verknüpfen. Konkret bedeutete das: QR-Codes in den 3D-Scans autonom zu erkennen und mit Informationen aus der Asset Administration Shell (AAS) zu verbinden. Das Ziel war eine begehbare, interaktive 3D-Szene, die nicht nur die Umgebung visualisiert, sondern auch Daten bereitstellt und Prozesse optimiert. Um die Ergebnisse übertragbar zu machen, wurde ein generischer Ansatz gewählt.

26.06.2025, Dresden, Thin[gk]athon, ZEISS Digital Innovation, Smart Systems Hub, Volkswagen Sachsen

Teamwork als Innovationsmotor

Die Teams, bestehend aus Teilnehmenden mit unterschiedlichstem fachlichen Hintergrund, bewiesen, wie wertvoll das Format ist. Durch die Kombination von Wissen aus IT, Produktion, Design und Wissenschaft entstanden neue Ideen, die konventionelle Denkweisen durch frische Impulse ersetzten. Auch unsere Kollegen Pawel Adaszewski und Gergely Honti von ZEISS Digital Innovation unterstützten die Teams mit ihrer Expertise in Softwareentwicklung und ihren Erfahrungen auf dem Shopfloor. Am Ende präsentierten alle Teams innerhalb von nur drei Tagen praxistaugliche Konzepte und skizzierten mögliche nächste Schritte für den Aufbau eines interaktiven und skalierbaren digitalen Zwillings.

Technologischer Deep Dive: Eine Herausforderung in drei Dimensionen

Die wahre Komplexität der Challenge zeigte sich in den Rohdaten. Die Datensätze lagen als sogenannte 3D Gaussian Splats vor – eine moderne Methode, aus Fotos fotorealistische Szenen zu rendern. Das Resultat: eine riesige und oft unsaubere Punktwolke, die zuerst von Rauschen gefiltert werden musste.

Einige Teams versuchten, die Dichte der Punktwolke mit dem K-Nearest-Neighbors-Algorithmus (KNN) zu analysieren, mussten diesen Ansatz aber wegen der enormen Datenmenge schnell verwerfen. Erfolgreicher war eine boxbasierte Methode, die den Raum in ein Voxel-Gitter aufteilte – man kann sich dies wie eine Aufteilung in kleine Würfel vorstellen. Durch die Berechnung der Punktdichte in jedem Würfel konnten Maschinencluster schnell und effizient isoliert werden.

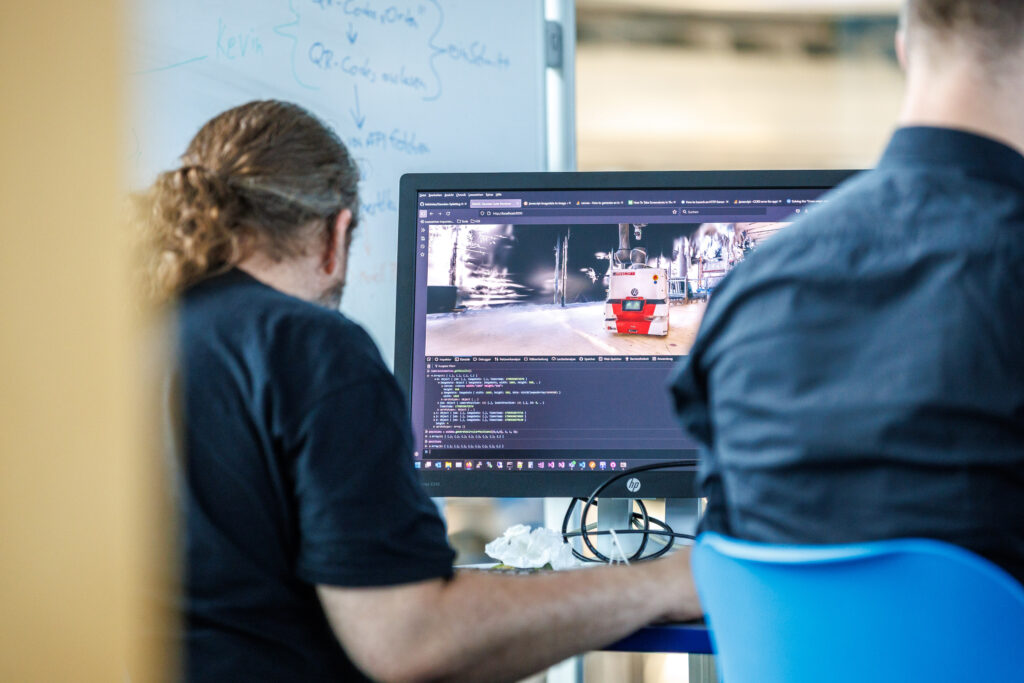

Die größte Hürde blieb die Detektion der QR-Codes. Die entscheidende Erkenntnis war, dass die 3D-Scans nur die Oberflächen der Objekte abbilden. Statt den gesamten 3D-Raum zu durchsuchen, konnten die Teams die gerenderte Oberfläche gezielt nach Bereichen mit hohem Schwarz-Weiß-Kontrast absuchen. Doch die praktische Umsetzung war steinig: Versuche, die gefundenen Kontrast-Hotspots mit Python-basierten 3D-Renderern zu visualisieren, scheiterten an Software-Konflikten und Bugs. Der Durchbruch gelang schließlich durch einen pragmatischen Wechsel zur Unity-Engine. Mittels WebGL-Rendering wurde die virtuelle Kamera an die berechneten Koordinaten bewegt, um die QR-Codes zu finden und auszulesen.

Nach der Vorverarbeitung wurde eine räumliche Beziehung zwischen den QR-Codes und den zugehörigen Maschinen hergestellt. Diese räumliche Beziehung wurde genutzt, um Daten aus der Asset Administration Shell (AAS) für den Nutzer zu beziehen und in einer interaktiven Nutzeroberfläche darzustellen. Ein mögliches Frontend erlaubte es den Nutzern, sich interaktiv in der Punktwolke zu bewegen und die relevanten Informationen zu erkunden.

Die Lösung des Gewinnerteams

Das Siegerteam der Professur Informationsmanagement der HTW Dresden – bestehend aus Stefan Vogt, Robert Pampuch, Johannes Metzler, Felix Fritzsche und Paul Patolla – überzeugte mit einer funktionierenden Lösung, die zugleich den Wettbewerb für sich entschied. Für sie waren es drei intensive Tage voller Technologie, Austausch und praxisnaher Entwicklung.

| „Diese Veranstaltung bringt die Herausforderungen der Wirtschaft und das Wissen aus der Forschung zusammen und zeigt, wie man in kurzer Zeit gemeinsam überzeugende Lösungen entwickeln kann.“ sagt Paul Patolla von der HTW Dresden. |

Die technische Verarbeitung ihrer Lösung basierte auf mehreren Schritten. Zunächst wurden Videodateien in Einzelbilder zerlegt, um in jedem Frame QR-Codes mitsamt Positionsinformationen zu identifizieren. Hierfür setzten sie insbesondere die Python-Bibliothek OpenCV ein, die eine effiziente Bildaufbereitung und robuste QR-Code-Erkennung ermöglichte. Parallel dazu nutzte das Team das Verfahren des Gaussian Splatting, basierend auf der wissenschaftlichen Veröffentlichung von Kerbl et al., um aus den Bilddaten eine realitätsnahe Punktwolke zu erzeugen. Dies ermöglichte die präzise Verortung der QR-Codes in einem dreidimensionalen Kontext.

Zur Visualisierung wurde Babylon.js eingesetzt, wodurch die Ergebnisse als WebXR-Anwendung direkt im Browser (und optional in VR) erlebbar wurden. Ergänzend kam NVIDIA Omniverse zur Generierung von Texturen zum Einsatz, um die visuelle Qualität der Darstellung deutlich zu steigern. Auf diese Weise entstand eine durchgängige Lösung, die Datenanalyse und immersive 3D-Visualisierung intelligent verband und den klaren Bezug zur Praxis demonstrierte.

Fazit und Ausblick

Eine Fachjury aus Expertinnen und Experten von Industrie und Wissenschaft bewertete die Konzepte nach technischer Tiefe, Umsetzbarkeit und Teamarbeit. Die Teams setzten ein starkes Zeichen für gesellschaftliches Engagement, indem sie ihr Preisgeld von 2.000 € an gemeinnützige Organisationen spendeten.

Links: Gewinnerteam „Punkt Pioniere“, rechts: Teilnehmende und Jury v.l.n.r. Prof. Marius Brade (Fachhochschule Dresden), Dr. Stefan Feldmann (Zeiss), Dr. Dirk Thieme (Volkswagen Sachsen), Daniel Beltz (Sachsenmilch), Leonid Dendya (Volkswagen)

Der Thin[gk]athon hat einmal mehr bewiesen, dass die Digitalisierung der Produktion kein Selbstzweck ist, sondern ein wirksames Werkzeug. Sie ermöglicht effizientere Prozesse und datenbasierte Entscheidungen, die nachhaltige Mehrwerte für den Shopfloor schaffen. Der Schlüssel zum Erfolg liegt im strukturierten Data Enablement und dem gezielten Einsatz vorhandener Produktionsdaten.

Die entwickelten Konzepte zeigen eindrucksvoll, wie durch die Kombination aus Technologie, Teamgeist und methodischer Begleitung komplexe Herausforderungen gelöst werden können. Wir freuen uns darauf, Formate dieser Art fortzuführen und den Austausch gemeinsam weiter voranzutreiben.